股票配资1比5

股票配资1比5

作者|Jessica

今天,OpenAI 2024年首场DevDay在旧金山2号码头的Gateway Pavilion低调举办。

与去年风风火火的官宣造势不同,今年开发者日的消息只在两月前OpenAI Developers 的X账号出现过一次,以至于好多人都不知道这事儿。

参会者基本是受邀客户和筛选出的一线开发者。地点保密至最后一刻,直至当天才透露的神秘日程,且没有直播。

会前,Sam Altman快速发布一条推特:

“今天为开发者推出了一些新工具!

从上次DevDay到这次:GPT-4到4o mini的每个token成本下降了 98%,我们系统中的token量增加了50 倍,模型智能取得了卓越进展,期间还有一点小drama。

我对从这次DevDay到下一次的进展充满期待。通向AGI的道路从未如此清晰。”

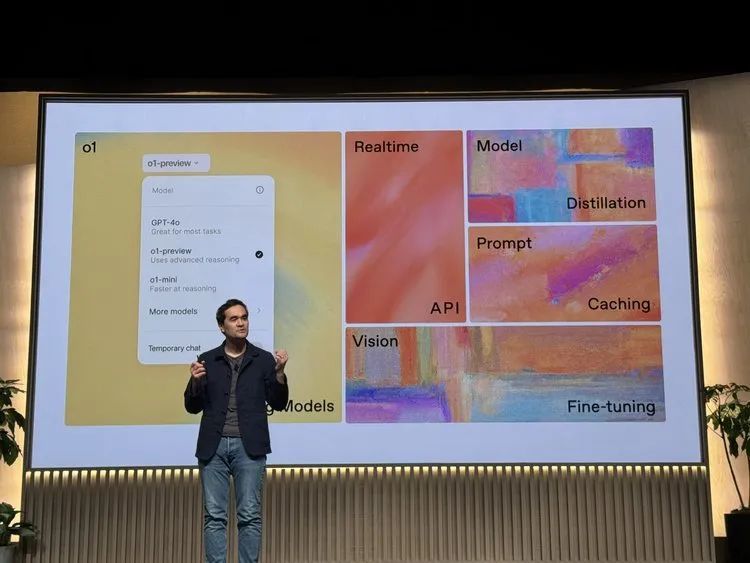

正如此前公司开发者体验主管Romain Huet在X平台告知的那样,今年的DevDay没有任何新模型发布,只集中在API改进。

而OpenAI也确实在这个名副其实的“开发者日”上,打包带来了实时API、提示缓存、模型蒸馏、视觉微调、Playground优化,以及扩大o1 API范围、提升速率限制等一系列面向开发者的重要工具更新。

而这些新API的定价并不是绝对便宜,许多开发者评价当它的定价与能力结合,才显得有吸引力。此次诚意尽显的开发者大礼包一次性奉上,OpenAI还是想通过卖最好的货,来赚最多的钱。

图源:@swyx | x.com

1

实时API:一步构建自己的“Her”应用

作为今天最吸睛的功能,实时API (Realtime API)允许开发者调用ChatGPT高级语音模式的底层模型gpt-4o-realtime-preview,在应用中构建快速、自然的语音到语音对话体验。支持6种预设语音,实现低延迟的语音交互。

以往创建语音助手时,开发者需要依赖多个模型来完成不同任务:先用类似Whisper的语音识别模型将音频转录成文本,再将文本传递给语言模型进行推理,最后通过文本到语音模型生成语音输出。不仅流程复杂,还容易丢失情感和口音,且存在明显延迟。

而实时API只需一次调用,即可完成整个对话流程。通过流式传输音频输入和输出,极大地提升了对话的自然性和响应速度。它使用持续的WebSocket连接与GPT-4o交换消息,并支持函数调用,能快速响应请求,执行如下订单或提供个性化服务等操作。还能像高级语音模式那样,自动处理中断,确保用户体验更加顺畅,非常适合客户支持、语言学习等需要高互动性的场景。

在现场,工作人员演示了通过实时API构建的语音助理,帮台下100多名开发者“打电话下单400颗草莓外送”的demo。

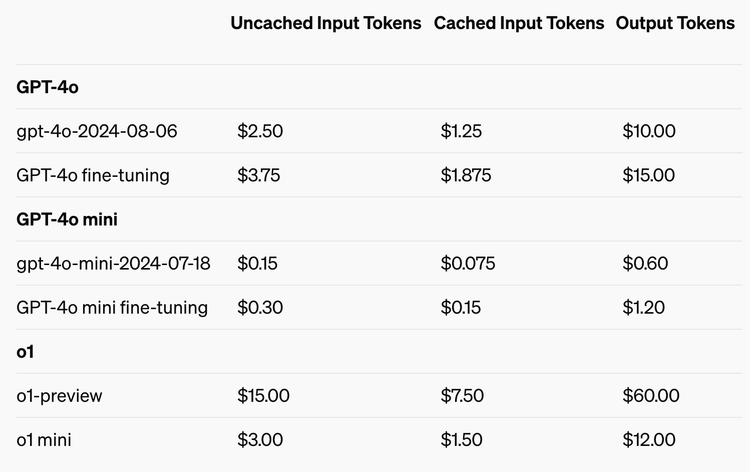

打开新闻客户端 提升3倍流畅度目前,实时API的公开测试版已向所有付费开发者开放。定价方面,每百万token输入5美元,输出20美元,约合每分钟音频输入0.06美元,输出0.24美元。

开发者可以通过Playground或官方文档快速入门,并借助LiveKit、Agora、Twilio等合作伙伴提供的音频组件库,集成回声消除、声音隔离等功能,从而轻松构建和部署语音助手。

OpenAI还计划逐步完善实时API,包括支持更多模态(视觉和视频)、提高速率限制、提供官方SDK、引入提示缓存、扩展到GPT-4o mini等模型,来进一步拓展开发者应用场景。

1

提示缓存:1小时内重复调用token享半价

许多开发者在构建AI应用时,常常会在多个API调用中使用相同的上下文,提示缓存正是为了减少重复调用的成本和延迟而生。

它能够自动保存开发者最近使用的输入内容,并在这些内容再次被调用时提供50%的费用折扣,同时加快处理速度。特别适合编辑代码库、或与聊天机器人进行长时间多轮对话等任务。

从今天起,提示缓存应用于GPT-4o、GPT-4o mini、o1-preview和o1-mini的最新版本,无需开发者额外操作。当提示长度超过1024个token时,API会自动保存已处理过的部分,并以128个token为单位进行增量缓存。缓存数据在5到10分钟不活动后自动清除,最多保存1小时,而且缓存数据不会在不同组织间共享。

1

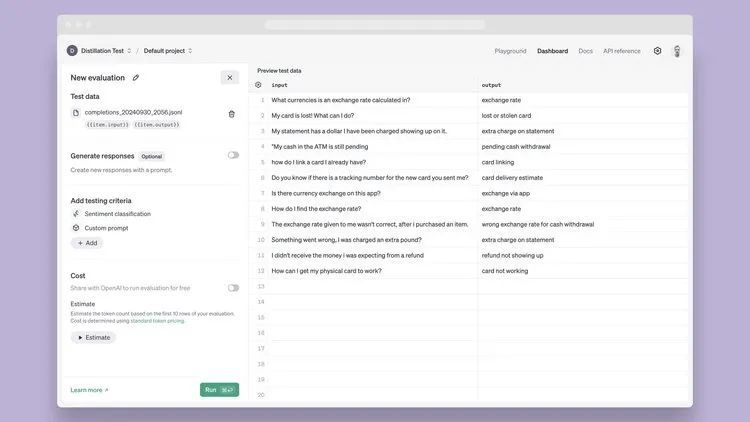

模型蒸馏:从零开始,一站式微调小模型

模型蒸馏是一项新功能,旨在通过使用大型、强大的模型(如GPT-4o或o1-preview)的输出,来微调更小、更具成本效益的模型(如GPT-4o mini),以在特定任务上接近高级模型的性能,但成本大大降低。

此前,蒸馏是一个复杂且容易出错的多步骤过程,开发者需要手动管理多个环节,如生成数据集、微调模型和评估性能等。现在,开发者可以在OpenAI平台上通过一体化的工作流程轻松完成这些任务。

提供的全新模型蒸馏套件包括:

1.存储完成(Stored Completions):通过API自动捕获并存储由GPT-4o或o1-preview等模型生成的输入输出对,快速生成用于蒸馏的数据集。

2. 评估(Evals):开发者可以创建自定义评估,衡量模型在特定任务上的性能,无需手动整合复杂的工具。

3. 微调功能集成(Fin-tuning):存储完成和Evals与现有的微调工具无缝整合。

在实际操作中,开发者首先通过Evals创建评估来检测目标模型(如GPT-4o mini)的表现。接着,使用存储完成功能,自动保存GPT-4o生成的输入输出对,创建适用于微调的真实数据集。这些数据经过审核和优化后可用于微调小模型。微调完成后,开发者可再次使用Evals来测试模型性能,确保其接近大型模型水平。

模型蒸馏现已对所有开发者开放。为鼓励开发者使用,OpenAI每天免费提供200万训练tokens用于GPT-4o mini,100万tokens用于GPT-4o,一直持续到10月31日。“存储完成”功能免费,Evals按token使用量收费。开发者选择与OpenAI共享评估结果后,还能获得每周免费运行7次Evals。

1

视觉微调:引入图像数据集,让AI更能“看懂”世界

GPT-4o的API新增了视觉微调功能,允许开发者除文本外,还可以使用图像进行模型定制。从而增强模型的图像理解能力,使其在诸如视觉搜索、物体检测、自动驾驶、智慧城市管理以及医学影像分析等领域更加擅长。

工作流程上,视觉微调与文本微调类似。开发者可以准备好格式化的图像数据集并上传到平台,仅使用100张图像就能显著提高模型的视觉任务性能。随着更多数据的加入,模型表现会持续增强。

例如,食品配送公司Grab就通过100个图像示例,教会了GPT-4o正确定位交通标志并计算车道分隔线。在基础GPT-4o模型上提高了20%的车道计数准确性和13%的限速标志定位准确性,大幅优化了地图数据。

视觉微调也已经即插即用,付费开发者现在就可以使用最新的GPT-4o版本“gpt-4o-2024-08-06”进行图像微调。OpenAI在10月31日前每天提供100万免费训练token,之后按每百万token 25美元收费。图像输入根据其大小计算,收费标准与文本输入一致。

除了以上四项主要工具更新外,OpenAI还为Playground新增了提示词优化功能:只需描述想用模型实现的功能,Playground就能自动生成提示词,以及有效的函数和结构化输出模式,快速将你的想法转化为实用原型。

新发布的o1 API继续宽限:扩大了第3层开发者的访问权限,提升各级别速率限制(tier 3每分钟5000),以使应用更快进入生产环境。具体定价与规格可以参考OpenAI Platform页面的Rate limits选项。

1

奥特曼现场答疑:仍注重研究、Agents未来完成1个月工作量、点赞NotebookLM、o2比各位都聪明

根据会议日程,主会场进行OpenAI团队的重要发布和各项更新讲解,分会场为合作伙伴展示及工作坊。

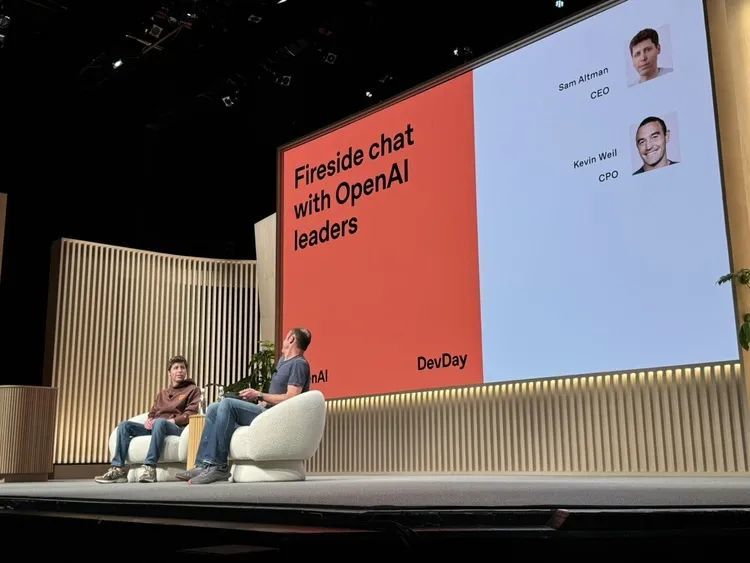

下午4点,OpenAI 首席执行官Sam Altman与6月新上任的首席产品官Kevin Weil登台,开始45分钟的炉边对话环节,对白天征集的与会者问题进行解答。

公开资料显示,王荣海现任安科生物董事、副总裁,并担任安科生物控股子公司安徽鑫华坤生物工程有限公司董事长。

图源:@swyx | x.com

根据推特用户@swyx现场整理,两人回答的问题涉及OpenAI使命、AGI、AI对齐、智能代理等方面。还特别点赞了谷歌的NotebookLM和Anthropic的Projects:

问:OpenAI是否依然致力于研究?

答:OpenAI比以往更加致力于研究。曾经我们只专注于扩大规模,其他公司模仿OpenAI也没问题。但当我们尝试创造全新的事物时,研究依然非常重要。OpenAI未来会继续将研究与产品紧密结合。

问:我们离AGI有多远?

答:通过o1,我们显然已经达到了第二个阶段。从上次DevDay的GPT-4 Turbo到o1之间的进展很大,接下来的两年发展速度会非常快。AGI将是一个平滑的指数增长过程,没有明确的界限或里程碑。没有人在意图灵测试被跨越的具体时刻,未来的历史学家回顾时或许会有不同的看法。

问:AI控制计算机的难题是什么?

答:安全性和一致性。

问:OpenAI只是口头上重视一致性吗?

答:我们非常关心构建安全的系统。希望开发出功能强大的模型,随着时间的推移,这些模型会变得越来越安全。o1显然是我们最强大的模型,同时也是我们最符合一致性的模型。

问:o1在年底前支持功能调用和系统提示吗?

答:模型会变得越来越好。o1现在处于GPT-2的规模,我们知道如何将它提升到GPT-4的水平,计划是让模型快速提升性能。

问:智能代理(Agents)如何融入OpenAI的长期规划?

答:聊天功能很棒,但如果想象能实现相当于人类数天努力的事情呢?目前人们谈论代理技术还不太严肃,但这将对世界的运作方式带来非常重大的改变。我们会要求代理完成一些需要一个月时间的任务,甚至多个任务。到2030年,人们将视这一切为理所当然。

问:使用AI作为核心功能的初创公司应该怎么做?

答:AI并不能让你摆脱正常的商业法则。

问:语音功能直接与人类体验相关,伦理方面的考量呢?

答:我会对ChatGPT说“请”和“谢谢”,其它你永远无法确定。

问:你欣赏竞争对手的哪个功能或能力?

答(Sam):NotebookLM,做得非常好。现在推出优秀新产品的人并不多。

答(Kevin):Anthropic的Projects做得非常出色。GPTs设计用于持久重复使用,而Anthropic的Projects较短暂,但其心智模型非常有效。

Altman还表示,希望高级语音模式以后能实现唱歌功能,但目前仍持保守态度。以及模型的长上下文能力将达到1000万token,10万亿token将在十年内实现(但并没有人说到OpenAI架构转换和7%股权的事)。

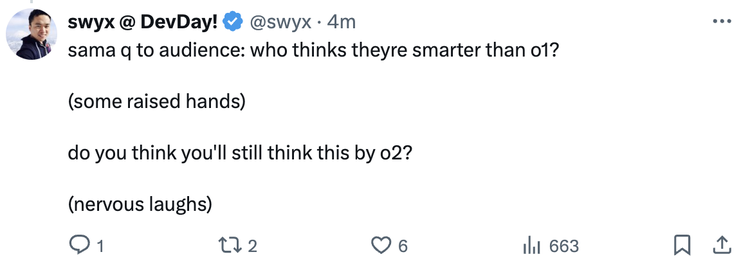

对话环节最后,Altman也向台下开发者们提了一个问题:“谁认为自己比o1更聪明?”

一些人举起了手。

“你觉得在o2发布时你还会这么认为吗?”Altman继续问道。

这次回应他的,只有略带紧张的笑声了。

1

OpenAI正在全力争取开发者

DevDay召开之际,恰好也是OpenAI筹集70亿美金重要融资、高层管理团队大换血、口碑形象连遭外界抨击的动荡关头。

首席产品官Weil在媒体简报中表示,公司的进展不会因为高管离职潮而放缓。

“现在我们拥有超过300万名开发者,在过去两年里API成本已降低了98%。”

从今天的高级语音、视觉微调、蒸馏等各种功能引入API,到整体价格降低和各种鼓励政策,再到排满的客户用例展示....足以看出,OpenAI正在说服广大开发者,自己仍然是构建AI应用的最佳平台。

但OpenAI的地位并非固若金汤。一名在硅谷做AI社交代理的开发者告诉硅星人,自己选用OpenAI API的理由是他们起步早,在很长一段时间内处于行业领先地位,尤其coding做得很好。能力稳定可用,调用方式简单,学习成本低,逐步降价对于开发者来说也可以接受。

“但是现在我们也考虑使用Claude。因为他们发展出了一种新的思路,就是通过伪代码的prompt去优化结果。这个从体验上很像o1,但是比o1更快更便宜。它的projects和super prompt功能非常牛逼。

OpenAI在那场风波之后明显研发陷入停滞。很多东西都没有在更新了。而 Claude就是一片生机勃勃,现在用Claude的人给我的感觉是更聪明,更会用AI的人。”

面对这些竞争,OpenAI这一次发布的这些API诚意满满,同时定价也并不算很低。

在模型层面没法直接降维打击遥遥领先的今天,OpenAI把重点放在争夺开发者身上,想要用最好的货,来吸引开发者和客户们。在今天的竞争里,谁都想要做赚最多钱的那个,这样才有可能为下一次遥遥领先的机会做好准备。

封面图源:@gooby_esq | x.com股票配资1比5